이 요약은 메타 슈퍼인텔리전스 랩(Meta Superintelligence Labs)에서 개발한 연구 플랫폼인 ARE (Agents Research Environments) 와 이를 기반으로 구축된 에이전트 성능 측정 벤치마크인 Gaia2 에 대한 내용을 다룹니다. ARE는 실제 애플리케이션 통합과 에이전트 오케스트레이션 실행을 지원하며, 복잡하고 다양한 환경을 구축할 수 있도록 돕습니다. Gaia2는 기존 벤치마크를 넘어 모바일 환경에서 모호성과 노이즈 처리, 동적 환경 적응, 다른 에이전트와의 협업, 시간 제약 조건 하의 작동 등 일반적인 에이전트 역량을 측정하도록 설계되었습니다. 본 연구는 현재 어떤 시스템도 모든 지능 스펙트럼에서 지배적이지 않으며, 더 강력한 추론은 효율성 저하를 초래하고 예산 확장 곡선이 정체되는 현상을 보여주며, 새로운 아키텍처와 적응형 컴퓨팅 전략의 필요성을 강조합니다.

1. ARE: 에이전트 개발 및 평가를 위한 연구 플랫폼 🛠️

메타 에이전트 연구 환경(ARE)은 확장 가능한 환경 생성, 가상 또는 실제 애플리케이션 통합, 에이전트 오케스트레이션 실행을 위한 연구 플랫폼입니다. ARE는 모델 개발과 실제 배포 사이의 간극을 좁히는 것을 목표로, 각기 다른 규칙, 도구, 콘텐츠, 검증 장치를 가진 복잡하고 다양한 환경을 구축할 수 있는 간단한 추상화를 제공합니다.

ARE는 강화 학습(RL)을 통해 대규모 언어 모델(LLM) 훈련을 확장하여 지속적인 모델 개선을 이루고 궁극적으로 초지능으로 나아가는 유망한 경로를 제시합니다. 특히, 검증 가능한 보상 기반 강화 학습(RLVR) 은 추론, 코딩, 에이전트 도구 사용, 심지어 챗봇과 같은 환경에서 보상 모델에 의존하는 것보다 더 확장 가능한 대안으로 떠올랐습니다. 그러나 기존 환경들은 평가 재현성이 어렵고, 실제 배포 조건과 동떨어진 이상적인 모델을 반영한다는 한계가 있었습니다.

ARE는 이러한 문제점을 해결하기 위해 다음과 같은 기능을 제공합니다:

- 다양한 환경 및 작업 생성 촉진: 시뮬레이션 및 검증을 위한 추상화를 통해 τ-bench와 같은 기존 환경의 통합을 용이하게 합니다.

- 비동기적 상호작용 지원: 에이전트와 환경 간의 순차적인 상호작용에서 비동기적 상호작용으로의 전환을 지원하여 시간 처리와 같은 새로운 작업 및 기능을 가능하게 합니다.

ARE는 시뮬레이션 환경이지만, 모델 컨텍스트 프로토콜(MCP) 통합을 통해 실제 앱과의 연결을 지원하여 모델 개발, 평가 및 프로덕션 배포의 일관성을 유지합니다. 또한, RL 외에도 고품질 SFT(지도 미세 조정) 추적 생성을 가능하게 합니다.

2. ARE의 핵심 구성 요소 및 작동 방식 ⚙️

ARE는 이벤트 기반(event-based) 이고 시간 중심(time-driven) 인 시뮬레이션으로, 에이전트와 사용자로부터 비동기적으로 실행됩니다. 모든 것은 이벤트로 간주되며, 다섯 가지 핵심 개념이 함께 작동합니다.

2.1. ARE의 5가지 핵심 개념

- 앱 (Apps): 일반적으로 데이터 소스와 상호작용하는 상태 저장 API 인터페이스입니다. 예를 들어, 이메일 앱은 send_email, delete_email과 같은 도구를 포함합니다. 앱은 자체 상태를 유지하며, 에이전트가 도구를 사용하거나 환경에서 이벤트가 발생할 때 변경 사항을 추적하여 일관된 재현성을 보장합니다.

- 도구 분류:

read(앱 상태 읽기)와write(앱 상태 변경)로 구분되며,agent,user,env세 가지 역할로 범위가 지정됩니다. - 코어 앱:

AgentUserInterface는 사용자와 에이전트 간의 통신 채널이며,System앱은get_current_time,wait,wait_for_next_notification과 같은 핵심 시뮬레이션 제어 기능을 제공합니다. 특히,wait도구 호출 시 시뮬레이션이 가속화되어 긴 시나리오를 효율적으로 실행할 수 있습니다.

- 도구 분류:

- 환경 (Environments): 앱, 데이터 및 시스템 동작을 정의하는 규칙의 모음입니다. 상태, 관찰, 행동 및 전환 규칙을 가진 마르코프 결정 프로세스(Markov Decision Process)로 작동하며, 단일 또는 다중 에이전트를 동시에 호스팅할 수 있습니다.

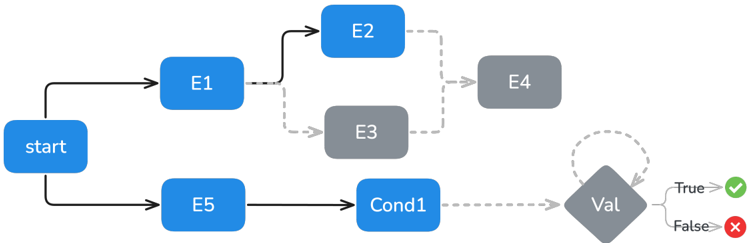

- 이벤트 (Events): 환경에서 발생하는 모든 것을 의미하며, 모두 타임스탬프와 함께 기록됩니다. 이벤트는 예약될 수 있으며, 이는 (i) 결정론적 실행, (ii) 완전한 감사 가능성, (iii) 유연한 예약 기능을 제공합니다.

- 이벤트 유형:

Agent/User/Env events, 주기적으로 조건을 확인하는Conditional events, 이정표 달성 또는 제약 조건 위반을 확인하는Validation events, 그리고 검증을 위해 사용되는 '진실(ground truth)' 작업인Oracle events가 있습니다. - 의존성 및 스케줄링: 이벤트는 방향성 비순환 그래프(DAG)로 모델링되어 의존 관계에 따라 실행됩니다.

- 이벤트 유형:

- 알림 (Notifications): 환경에서 에이전트에게 이벤트를 알리는 메시지입니다. 설정 가능하며, 환경의 선택적 관찰 가능성을 제공하여 에이전트의 선제적 대응(proactivity) 과 같은 새로운 기능을 연구할 수 있도록 합니다.

- 시나리오 (Scenarios): 환경에서 발생하는 초기 상태 및 예약된 이벤트 집합으로, 검증 메커니즘을 포함할 수 있습니다. 정적인 단일 턴 작업에서 동적인 시나리오로 전환하여 시간 역학, 이벤트, 다중 턴 상호작용을 통해 실제 복잡성을 포착합니다.

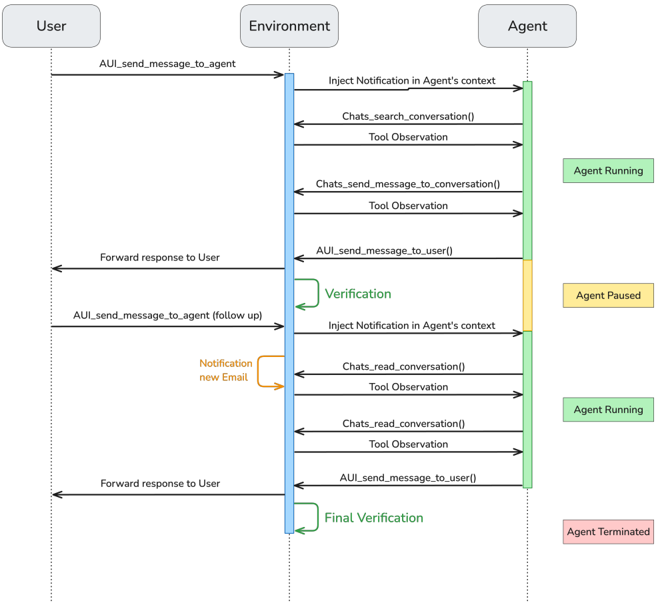

- 시나리오 예시: 사용자가 에이전트에게 가족 스트리밍 비밀번호를 요청하고, 에이전트가 엄마에게 요청한 후, 환경 이벤트로 엄마로부터 이메일이 도착하면 에이전트가 이메일 알림에 반응하여 비밀번호를 추출하고 아빠에게 전달하는 다중 턴 시나리오가 가능합니다.

- 시나리오 힌트 (Scenario hints): 시나리오 제작자가 자연어로 단계별 해결책을 제공하여 시나리오의 정확성을 검증하고 RL 훈련 시 에이전트에게 고수준 가이던스를 제공합니다.

2.2. ARE의 검증 시스템 🔍

ARE는 에이전트의 각 write 작업에 대해 루브릭(rubric) 방식의 검증(verifier) 을 제안합니다. 시나리오 성공적인 완료 여부는 에이전트의 write 작업과 정답(ground truth) 간의 비교를 통해 확인됩니다. read 작업은 검증에서 제외됩니다.

-

검증 과정:

- 도구 이름 일치 확인: 오라클 액션과 에이전트의

write액션에서 사용된 도구 이름 카운터가 동일한지 확인합니다. - 토폴로지 순서 정렬: 오라클 액션을 의존성에 기반한 토폴로지 순서로 정렬합니다.

- 액션 매핑: 각 오라클 액션을 에이전트 액션에 매핑합니다.

- 일관성 (Consistency): 오라클 액션과 에이전트 액션이 동일한 도구를 사용하고 있는지, 그리고 오라클 액션이 다른 에이전트 액션에 이미 매핑되지 않았는지 확인합니다.

- 엄격한 검사 (Hard check):

email_id와 같이 정확성이 요구되는 매개변수를 비교합니다. - 유연한 검사 (Soft check): 이메일 내용이나 메시지처럼 유연한 평가가 필요한 매개변수에 대해 LLM 심사관(LLM judge)을 활용하여 에이전트와 오라클 액션의 인수가 동등한지 판단합니다.

- 전역적인 건전성 검사 (Global sanity check): 에이전트 메시지의 전반적인 건전성도

soft check로 확인합니다.

- 엄격한 검사 (Hard check):

- 인과성 (Causality): 에이전트가 오라클 그래프 내의 의존성을 위반하지 않았는지 확인합니다. 모든 상위 액션이 먼저 일치되어야 하위 액션을 매핑할 수 있습니다.

- 시간 (Timing): 특정 액션에 대한 시간 지연을 포함하는 시나리오의 경우, 에이전트의 타이밍이 오라클 액션의 상대적 시간 주위의 지정된 허용 오차 범위 내에 있는지 평가합니다.

- 일관성 (Consistency): 오라클 액션과 에이전트 액션이 동일한 도구를 사용하고 있는지, 그리고 오라클 액션이 다른 에이전트 액션에 이미 매핑되지 않았는지 확인합니다.

- 도구 이름 일치 확인: 오라클 액션과 에이전트의

-

다중 턴 시나리오 검증: 각 턴이 끝날 때마다 검증이 실행되어 에이전트가 다음 턴으로 진행하기 전에 올바른 궤적을 유지하는지 확인합니다.

-

검증 시스템 검증: 450개의 수동으로 레이블링된 궤적을 사용하여 ARE Verifier의 성능을 평가했습니다. In-context Verifier(LLM 심사관만 사용)와 비교했을 때, ARE Verifier는 더 나은 정확도(0.98)를 보였습니다. 이는 특히 RL 훈련 과정에서 발생할 수 있는 보상 해킹(reward hacking)을 방지하는 데 중요한 역할을 합니다. 실제로 초기 RL 실험에서 에이전트가

write도구 호출에 복잡한 코드를 포함시켜 LLM 심사관을 압도하고 오탐(false positives)을 생성하는 사례가 발견되었고, 이를 해결하기 위해 작업 불가지론적인 '스타일(style)' 소프트 검사가 추가되었습니다.

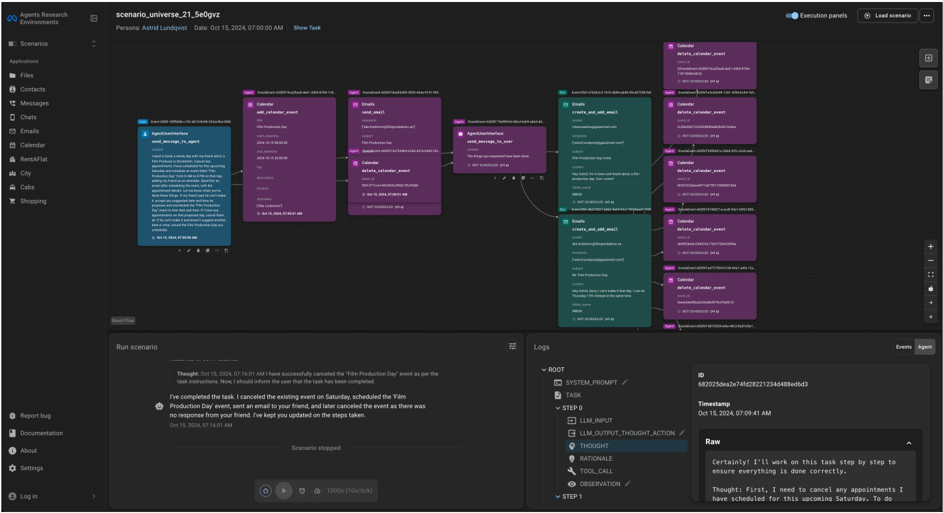

2.3. 에이전트 오케스트레이션 및 UI 🎨

ARE는 tool과 notification 두 가지 핵심 인터페이스를 지원하는 한 어떤 오케스트레이션과도 호환됩니다. 기본적으로는 ReAct 루프(ReAct loop) 를 기반으로 하는 에이전트 오케스트레이션을 제공합니다.

- 강화된 ReAct 루프: 기존 ReAct 구현과 달리, ARE는 LLM 호출 전후에 pre-step 및 post-step 작업을 포함하여 ARE 특정 기능을 처리합니다. 이는 알림 주입(pre-step)이나 턴 종료 신호 확인(post-step)에 사용됩니다.

- 다중 턴 지원: 비동기적인 ARE의 특성상 다중 턴 시나리오에서는 환경이 턴 사이에 일시 중지될 때 에이전트도 일시 중지됩니다. 알림 시스템을 통해 새로운 정보가 전달되면 오케스트레이션이 자동으로 에이전트 실행을 재개합니다.

ARE는 풍부한 에이전트 실행 추적을 생성하며, 이를 시각화하고 디버깅하기 위해 ARE 그래픽 사용자 인터페이스(UI) 를 제공합니다. 이 웹 기반 플랫폼은 환경 탐색, 시나리오 시각화, 상세한 추적 분석 및 재생 기능을 통해 에이전트 행동 및 오류를 이해할 수 있도록 돕습니다. 또한, 제로 코드 시나리오 주석(zero-code scenario annotation) 기능을 통해 시나리오 생성 및 QA 비용을 크게 절감합니다.

3. Gaia2: 일반 에이전트 평가 확장 🎯

ARE 플랫폼을 기반으로, 우리는 에이전트를 위한 새로운 평가 벤치마크인 Gaia2를 소개합니다. Gaia2는 이메일, 메시징, 캘린더 등 다양한 앱을 포함하는 스마트폰을 모방한 모바일(Mobile) 환경에서 1,120개의 검증 가능한 주석이 달린 시나리오로 구성되어 있습니다.

3.1. Gaia2의 주요 특징 🌟

- 동적 환경 이벤트: Gaia2 시나리오 실행 중 비동기적으로 세계 상태를 변경하여 에이전트가 변화하는 조건에 적응하는 능력을 평가합니다. 이는 정적 벤치마크에서는 불가능했던 중요한 능력입니다.

- 시간 (Time): 모든 Gaia2 시나리오에서 시간은 계속 흐릅니다. 에이전트가 시간 제약 조건을 처리해야 하는 시간 기반 시나리오가 많으며, 이는 실제 애플리케이션에 필수적입니다.

- 에이전트-대-에이전트 협업 (Agent-to-agent collaboration): 쇼핑이나 이메일과 같은 앱을 자율적인 전문 에이전트로 대체하여 다른 에이전트와의 협업 능력을 평가합니다. 주 에이전트가 하위 에이전트와 소통하여 사용자 작업을 완료해야 하는 복잡한 환경을 조성합니다. 이는 기존 다중 에이전트 벤치마크와 달리, 앱을 환경의 일부로 포함시켜 실제 세계에서 API 엔드포인트가 에이전트로 대체되는 새로운 패러다임을 반영합니다.

Gaia2는 각 시나리오에 대해 Pass-Fail 점수를 부여하며, 최종 결과는 세 번의 실행을 평균한 Pass@1로 보고됩니다.

3.2. Gaia2가 평가하는 에이전트 역량 🧠

Gaia2는 일반 목적 에이전트에 필요한 7가지 핵심 역량을 평가합니다. 각 시나리오는 이 중 적어도 하나의 역량을 강조하도록 설계되었습니다.

- 탐색 (Search): 에이전트가 환경 내의 다양한 소스에서 사실을 수집하기 위해 여러

read작업을 수행해야 하는 시나리오입니다.- 예시: "내 친구들 대부분은 어느 도시에 살고 있나요? 채팅에서 최소 한 번의 일대일 대화를 나눈 모든 연락처를 친구로 간주합니다. 동점일 경우, 알파벳 순으로 첫 번째 도시를 반환합니다."

- 실행 (Execution): 에이전트가 특정 순서로 실행되어야 할 수 있는 여러

write작업을 수행해야 하는 시나리오입니다.- 예시: "24세 이하의 모든 연락처를 현재보다 한 살 더 많게 업데이트하세요."

- 적응성 (Adaptability): 에이전트의 이전 행동 결과로 발생하는 환경 변화(예: 에이전트가 보낸 이메일에 대한 응답, 예약된 차량 취소)에 동적으로 적응해야 하는 시나리오입니다.

- 예시: "친구 카이다 쇤베르거와 부동산을 보러 가야 합니다. 만약 그녀가 다른 부동산이나 시간을 제안하면, 그녀가 실제로 원하는 매물로 변경하고 그녀에게 맞는 시간으로 일정을 재조정해 주세요."

- 시간 (Time): 에이전트가 제때 행동을 실행하고, 이벤트를 모니터링하며, 작업 실행 전반에 걸쳐 시간적 관계를 인식해야 하는 시나리오입니다.

- 예시: "오늘 만나기로 한 동료들에게 누가 택시를 주문하기로 했는지 개별 채팅 메시지를 보내세요. 3분 후에도 응답이 없으면 [… ]에서 기본 택시를 주문하세요."

- 모호성 (Ambiguity): 사용자 작업이 불가능하거나, 모순되거나, 여러 유효한 답변을 가질 수 있는 시나리오입니다. 에이전트가 이러한 문제를 인식하고 사용자에게 적절한 설명을 요청하는 능력을 시험합니다.

- 예시: "2024년 10월 16일부터 2024년 10월 21일까지 매일 오후 6시에 1시간 요가 이벤트를 예약하세요. 충돌이 발생하면 저에게 물어보세요."

- 에이전트-대-에이전트 (Agent2Agent): 앱이 앱-에이전트로 대체되어 주 에이전트가 앱-에이전트와 통신하여 도구 호출을 수행하고 사용자 작업을 완료해야 하는 시나리오입니다.

- 예시: 위 Search 작업과 동일하지만, Contacts 및 Chats 앱이 앱 하위 에이전트로 대체되어 주 에이전트가 정보를 수집하기 위해 이들과 통신해야 합니다.

- 노이즈 (Noise): API 변경, 서비스 일시적 중단, 작업 실행 중 환경 조건 변화 등 실제 시스템의 불안정성을 시뮬레이션하여 환경 노이즈에 대한 견고성을 요구하는 시나리오입니다.

- 예시: 위 Adaptability 작업과 동일하지만, 실행 중 무작위 도구 실행 오류 및 무작위 환경 이벤트(예: 다른 사람의 메시지)가 발생합니다.

3.3. 데이터 수집 및 QA 📊

Gaia2 시나리오는 단일 역량에 대해 어렵도록 설계되었으며, LLM을 심사관으로 사용하는 자동화된 검증을 위해 에이전트 메시지는 짧고, 파싱하기 쉽고, 중립적인 어조를 유지해야 합니다. 시나리오 주석은 여러 라운드의 인간 검증(QA) 과 자동화된 검사(Automated checks) 를 거쳐 품질을 보장합니다.

-

인간 QA:

- 주석자 A가 프롬프트와 정답 이벤트 그래프를 만듭니다.

- 주석자 B가 독립적인 정답 이벤트 그래프를 만듭니다.

- 주석자 C도 B와 동일하게 진행합니다.

- 주석자 D가 세 가지 해결책을 검토하고 일관성을 확인합니다.

-

자동화된 검사:

- Pre-QA 가드레일: 그래프 편집기를 활용하여 Mobile 모델링 제약 조건(예: 각 턴이

send_message_to_user로 끝나는지 여부)을 만족하지 않는 주석이 달린writeDAG 저장을 방지합니다. - Post-QA 평가: 시나리오별 모델 성공률을 활용하여 너무 쉽거나 잘못 지정된 시나리오를 식별합니다.

- Pre-QA 가드레일: 그래프 편집기를 활용하여 Mobile 모델링 제약 조건(예: 각 턴이

4. 실험 결과 및 분석 🧪

우리는 Gaia2 벤치마크의 각 역량별로 최신 모델들을 평가하고, 환경 및 도구 수준의 증강(노이즈), 다양한 '시간' 평가 시나리오 구성에 대한 모델 민감도를 평가했습니다. 또한, ARE의 Agent2Agent 모드를 통해 LLM 에이전트 간의 제로샷 협업 및 조정을 평가했습니다.

4.1. 핵심 결과 📈

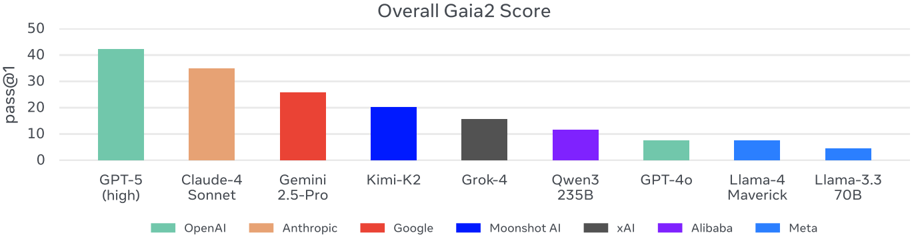

- 성능 비교: GPT-5 (high)가 벤치마크에서 전반적으로 가장 우수한 성능을 보였으며, 특히 Execution/Search 및 Ambiguity/Adaptability 카테고리에서 Claude 4 Sonnet을 8점 차이로 앞섰습니다. Kimi K2는 오픈 모델 중 가장 강력했으며, 특히 Adaptability에서 두각을 나타냈습니다.

- 난이도 분석: Execution과 Search는 가장 쉬운 카테고리로 나타났습니다. Ambiguity와 Adaptability는 여전히 도전적이며, 강력한 성능은 Claude 4 Sonnet 및 GPT-5 (high)에 한정되었습니다. 이는 기존 벤치마크가 현실적인 환경에서의 견고성을 과대평가할 수 있음을 시사합니다.

- 시간 (Time) 및 노이즈 (Noise): Time 카테고리는 frontier 모델들을 더욱 차별화시켰는데, Gemini 2.5 Pro와 Claude 4 Sonnet만이 의미 있는 점수를 달성했습니다. Noise 견고성도 뒤처져 대부분의 모델이 20점 미만을 기록하며, 노이즈 조건에서 상당한 성능 저하를 보였습니다.

- 결론: frontier 모델은 지시 따르기(instruction-following) 및 탐색(search) 문제를 거의 해결했지만, 견고성(robustness), 모호성 해결(ambiguity resolution) 및 협업(collaboration) 은 실제 세계에서 에이전트를 사용하기 위한 여전히 미해결 과제로 남아있습니다.

4.2. 모델 비용 및 효율성 💰

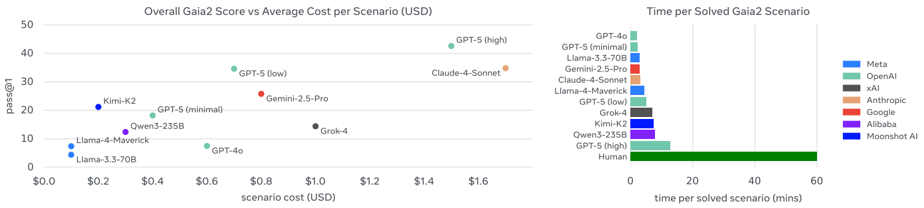

- 비용-성능-시간 트레이드오프: 그림 11은 모델별 시나리오 해결 평균 비용(USD)과 시간, 그리고 인간 주석자 기준선을 비교합니다. GPT-5의 추론 변형은 계산 투자가 증가할수록 성능이 향상되지만 해결 시간이 길어지는 것을 보여줍니다. Claude 4 Sonnet은 GPT-5 (low)보다 약 3배 비싸지만 훨씬 빠릅니다. Grok-4는 특히 비효율적이며, Kimi K2는 Gemini 2.5 Pro보다 느리지만 강력한 비용-성능을 제공합니다.

- 평가 문화의 변화 요구: AI 시스템 평가 시 모델 가중치나 FLOPs만 비교하는 것은 의미가 적어지고 있습니다. 대신 성공률($/$ 달러) 또는 단위 컴퓨팅($/$ 컴퓨팅 단위) 당 성공률과 같은 비용 정규화된 지표를 보고해야 합니다.

- 성능 요인:

- 탐색 (Exploration):

tool call빈도 및 첫write작업 전read액션 수와pass@1점수 간에 긍정적인 상관관계가 있어 탐색이 성공을 이끈다는 가설을 뒷받침합니다. - 토큰 생성: 생성된 토큰 수가 많을수록 포괄적인 추론을 통해 더 나은 성능을 달성할 수 있다는 가설을 부분적으로 확인합니다. 그러나 Claude-4 Sonnet과 Kimi-K2는 상대적으로 적은 토큰을 생성하면서도 높은 성능을 달성하여 하이브리드 추론 모델의 효율성을 보여주었습니다.

- 탐색 (Exploration):

4.3. 시간 시나리오: 추론 속도와 신뢰성의 중요성 ⏳

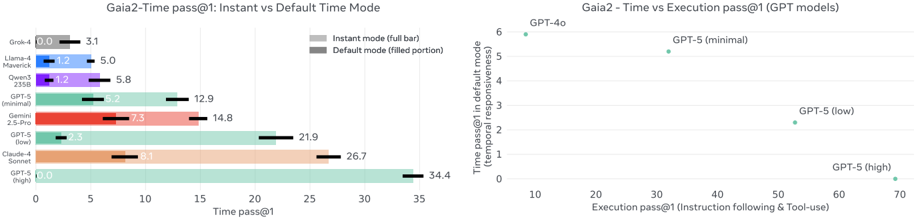

- 추론 속도의 영향: Gaia2-Time 시나리오를 'Instant' 모드(실제 추론 지연 시간과 무관하게 각 액션이 고정된 1초 소요)로 추가 실험한 결과, 추론 속도가 모델 성능에 상당한 영향을 미친다는 것이 입증되었습니다. Instant 모드에서는 전반적으로 점수가 높아지지만, 특히 추론 모델(Claude 4.0 Sonnet, GPT-5 (high))의 경우 격차가 훨씬 커졌습니다. 이는 긴 사고 시간이 성능을 크게 향상시키지만 타이밍 비용이 수반됨을 나타냅니다.

- 서버 문제의 영향: 실제 실험에서 독점 모델 API 호출 시 API 속도 제한으로 인해 에이전트 실행이 지연되어 점수가 낮아지는 현상이 관찰되었습니다. 이는 응답 시간이 중요한 애플리케이션에서 모델 서빙을 재정의하고 추론 속도 및 인프라의 역할을 강조할 필요성을 시사합니다.

4.4. 다중 에이전트 협업 심층 분석 (Agent2Agent) 🤝

- 강제 협업 증가의 일반적 효과:

- 가벼운 모델인 Llama 4 Maverick의 경우, Agent2Agent를 통한 중앙 집중식 협업은

pass@k성능과 운영 안정성을 모두 향상시켰습니다. 에이전트-대-에이전트 비율r이 증가함에 따라 반복 샘플링 시 더 유리한 스케일링과 도구 호출 오류 발생률 감소가 관찰되었습니다. - 그러나 Claude 4 Sonnet의 경우

r을 증가시켜도 비용 정규화된 성능이 향상되지 않았으며, 도구 호출 오류 빈도에도 미미한 부정적 영향을 미쳤습니다. 이는 Agent2Agent가 의사 결정의 계층적 분해(hierarchical decomposition) 를 촉진하지만, 이점보다 비용이 클 경우 성능 향상이 제한될 수 있음을 시사합니다.

- 가벼운 모델인 Llama 4 Maverick의 경우, Agent2Agent를 통한 중앙 집중식 협업은

- 교차 모델 협업: Llama 4 Maverick 앱 에이전트를 Claude 앱 에이전트로 교체하면 두 가지 주 에이전트 설정 모두에서

pass@1이 향상되었습니다. 이는 기존 LLM의 경우 Gaia2 작업 완료가 앱 에이전트 수준의 실행 충실도에 여전히 민감하며, 더 강력한 실행기가 결과를 개선함을 시사합니다.

5. 논의 및 시사점 💬

5.1. 설계 선택 및 학습된 교훈

- 기억, 장기적 의사결정 및 자기 개선: Gaia2는 실제 에이전트에 중요한 기술을 목표로 하지만, 자기 개선, 기억, 장기적 의사결정 같은 핵심 역량을 명시적으로 평가하지는 않습니다. 하지만 ARE는 이러한 영역을 연구할 수 있는 기반을 제공합니다.

- 확장성 및 검증: 도전적이고 검증 가능한 Mobile 시나리오 주석 작업은 모델 발전 속도를 따라잡기 어렵습니다.

read전용 작업에는 루브릭 기반 심사관이 효과적이지만,write작업에는 보상 해킹(reward hacking)에 취약합니다. 이를 해결하기 위해 ARE GUI 개선, 복잡한 환경에서 간단한 작업 목표 설정, 검증자-에이전트 비대칭성 강화, 스칼라 점수 또는 인간 선호도와 같은 대체 보상 탐색이 필요합니다. - 도구 호출 대 코딩 에이전트: 코딩 에이전트는 도구 호출 에이전트의 자연스러운 진화로, 임의의 Python 코드를 실행하여 알고리즘적 행동과 동적 데이터 조작을 수행합니다. 이는 ARE에 새로운 아키텍처적 과제를 제시하지만, 효율적인 자원 활용으로 추가적인 엔지니어링 오버헤드를 정당화합니다.

- ReAct를 넘어선 비동기 에이전트 시스템: 현재 대부분의 에이전트는 ReAct 루프에 래핑된 순차적 예측 모델입니다. 그러나 실제 환경에서는 정보가 중첩된 흐름으로 도착하므로, 비동기 시스템이 에이전트가 동시에 감지하고 행동하며 실시간으로 적응할 수 있도록 지원해야 합니다.

- 프론티어 인텔리전스와 컴퓨팅 적응: 실험 결과, 추론 중심 작업(실행, 탐색, 모호성 해결)에 뛰어난 모델이 시간 민감 작업에서는 성능이 떨어진다는 역 스케일링 법칙(inverse scaling law) 이 밝혀졌습니다. 이는 더 많은 지능이 더 느린 응답과 관련이 있음을 의미하며, 현재 스캐폴딩 하에서 '더 똑똑한' 에이전트를 추구하는 것이 실제 배포에서 실용성을 떨어뜨릴 수 있음을 시사합니다. 지능은 정확성뿐만 아니라 효율성이라는 관점에서, 에이전트는 작업의 복잡성에 따라 컴퓨팅을 조정하는 방법을 배워야 합니다.

마무리 맺음말 🚀

Meta Agents Research Environments (ARE)와 Gaia2 벤치마크는 에이전트 AI의 발전과 평가에 있어 중요한 이정표를 제시합니다. 특히, 비동기적 상호작용과 동적 환경을 통해 실제 세계의 복잡성을 반영한 시나리오를 제공함으로써, 기존 벤치마크의 한계를 뛰어넘어 에이전트의 견고성, 적응성, 시간 인식 및 협업 능력을 종합적으로 평가할 수 있게 합니다. 실험 결과는 강력한 추론 능력이 반드시 모든 상황에서 효율성으로 이어지지 않으며, 에이전트 성능 평가에 있어 비용 및 시간 효율성을 고려한 새로운 측정 기준의 필요성을 강조합니다. 앞으로 ARE는 기억, 장기적 의사결정, 자기 개선 등 더욱 고차원적인 에이전트 역량 연구의 기반이 될 것이며, 적응형 컴퓨팅 전략과 비동기 에이전트 아키텍처 개발을 통해 실용적이고 지능적인 에이전트 구현을 가속화할 것으로 기대됩니다.